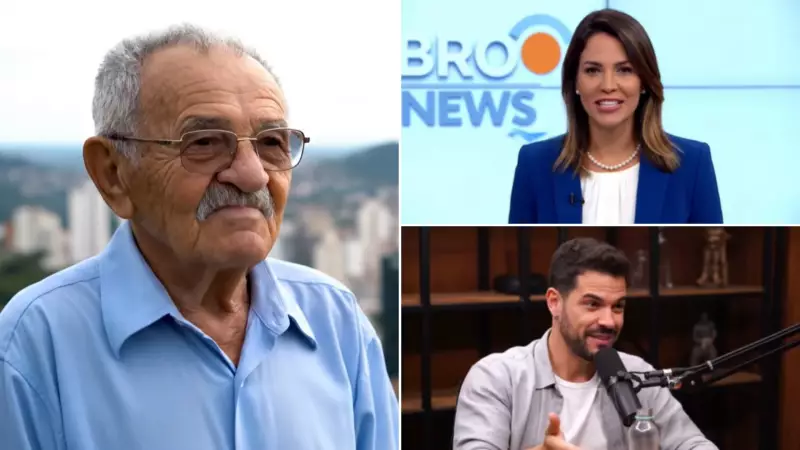

A mais recente criação do Google em inteligência artificial, o Veo 3, está causando furor nas redes sociais. Capaz de gerar vídeos impressionantemente realistas com apenas alguns comandos de texto, a ferramenta promete revolucionar a produção de conteúdo digital.

No entanto, especialistas já alertam para os riscos dessa tecnologia, principalmente em um ano de eleições municipais no Brasil. "A capacidade de criar vídeos falsos, mas extremamente convincentes, pode se tornar uma arma poderosa para espalhar desinformação", explica a pesquisadora em tecnologia digital Mariana Torres.

Como funciona o Veo 3?

O sistema utiliza aprendizado de máquina avançado para:

- Interpretar descrições textuais complexas

- Gerar cenas com iluminação e movimentos naturais

- Criar personagens consistentes em diferentes cenas

- Produzir vídeos de até 60 segundos com alta qualidade

Preocupações sobre o uso indevido

Embora o Google afirme ter implementado sistemas de verificação, muitos usuários demonstram preocupação:

- Facilidade para criar deepfakes convincentes

- Risco de manipulação em períodos eleitorais

- Dificuldade em distinguir conteúdo real de gerado por IA

- Impacto na credibilidade de vídeos autênticos

"Estamos diante de um desafio sem precedentes para a democracia digital", alerta o professor de direito tecnológico Carlos Mendes. "A regulamentação precisa acompanhar o ritmo dessas inovações."

O que diz o Google?

A empresa afirma que está trabalhando com autoridades e especialistas para desenvolver soluções que mitiguem os riscos, incluindo:

- Marcas de identificação em vídeos gerados por IA

- Ferramentas de detecção para plataformas

- Parcerias com órgãos de verificação de fatos

Enquanto isso, o debate sobre os limites éticos da inteligência artificial continua aquecido, com o Veo 3 no centro das atenções.