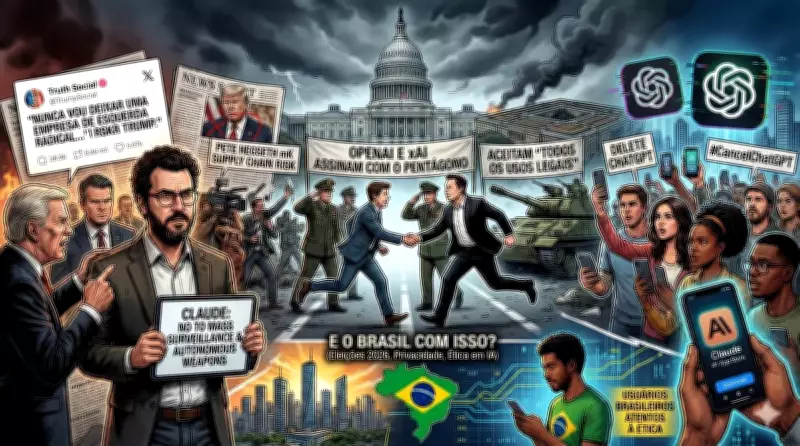

Pentágono bane Anthropic após recusa ética; OpenAI e Grok assumem contratos militares

Uma polêmica envolvendo inteligência artificial e ética militar transformou o cenário tecnológico nos Estados Unidos na última semana de fevereiro de 2026. Em menos de 48 horas, o governo americano converteu uma negociação de contrato militar em um caso emblemático de princípios éticos, política e confiança pública. O desfecho foi drástico: uma empresa foi oficialmente banida pelo Pentágono, enquanto outras foram rapidamente recrutadas para preencher o vazio.

O passo a passo da crise ética no Pentágono

A empresa Anthropic, criadora do modelo Claude, mantinha um contrato de até US$ 200 milhões para implementar sua inteligência artificial em redes classificadas do Exército americano. O Pentágono exigiu que a companhia removesse as chamadas "guardrails" ou limites éticos, permitindo dois usos específicos:

- Vigilância em massa de cidadãos americanos através da análise de dados públicos em larga escala

- Armas autônomas letais operando sem supervisão humana direta

O CEO Dario Amodei declarou publicamente: "Não podemos, em sã consciência, aceitar isso". A empresa solicitou garantias contratuais explícitas sobre os limites de uso. O Pentágono ofereceu concessões, mas manteve a recusa em incluir uma cláusula específica sobre "análise de dados em massa", levando a Anthropic a rejeitar o acordo.

Intervenção presidencial e banimento federal

Na sexta-feira, 28 de fevereiro, o presidente Donald Trump publicou no Truth Social: "Nunca vou deixar uma empresa de esquerda radical ditar como nosso exército luta!". Em questão de horas, uma série de medidas foi implementada:

- Ordenou que todas as agências federais cessassem o uso de tecnologia Anthropic, estabelecendo prazo de seis meses para transição completa

- O secretário de Defesa Pete Hegseth classificou a empresa como "risco de cadeia de suprimentos", terminologia normalmente reservada para companhias chinesas ou russas

- A GSA (General Services Administration), equivalente ao "Compras.gov" americano, removeu o Claude da lista de ferramentas aprovadas para uso governamental

OpenAI e Grok assumem rapidamente os contratos

Horas após o banimento da Anthropic, Sam Altman anunciou que a OpenAI havia fechado acordo para implementar seus modelos em redes classificadas do Pentágono. Elon Musk já havia estabelecido acordo similar semanas antes com o Grok, da xAI.

Ambas as empresas aceitaram o termo "all lawful purposes" (todos os usos legais), mas implementaram salvaguardas técnicas adicionais. A OpenAI reconheceu posteriormente que "foi corrida demais e as aparências não ficaram boas", ajustando o contrato após repercussão negativa inicial.

Reação pública e migração em massa de usuários

A resposta dos consumidores foi imediata e significativa:

- O aplicativo Claude saltou para o primeiro lugar no ranking de apps gratuitos da App Store americana, superando o ChatGPT no sábado e mantendo a posição

- A hashtag #CancelChatGPT explodiu no Reddit, acumulando mais de 33 mil upvotes em uma única publicação

- Milhares de usuários relataram estar deletando o ChatGPT e migrando para o Claude por "respeito à ética" e princípios morais

Impactos e reflexões para o Brasil

No cenário brasileiro, o episódio ganha relevância por múltiplas razões:

Eleições 2026: O Tribunal Superior Eleitoral já proibiu conteúdo novo gerado por inteligência artificial nas 72 horas anteriores à votação e exige marcação clara. Esta controvérsia demonstra que a ética em IA transcende o discurso ativista, tornando-se questão de segurança nacional e confiança pública.

Empresas brasileiras utilizando IA: Muitas pequenas e médias empresas, assim como grandes corporações, estão migrando para Claude, Grok ou Gemini. O episódio revela que nem todas as inteligências artificiais são equivalentes: algumas priorizam "velocidade militar", enquanto outras estabelecem limites éticos fundamentais.

Privacidade e mercado de trabalho: Se o governo americano debate abertamente vigilância em massa e armas autônomas, questões urgentes surgem sobre a proteção de dados de cidadãos brasileiros armazenados em servidores estrangeiros e os impactos no emprego.

Recomendações práticas para usuários e empresas brasileiras

- Teste o Claude gratuitamente para compreender as diferenças éticas entre plataformas

- Questionar sempre: "Esta IA possui salvaguardas contra uso indevido?" - empresas responsáveis estão respondendo publicamente

- Para organizações: preferir ferramentas com compromisso escrito contra vigilância em massa e decisões autônomas de alto risco, como aprovação de crédito, demissões ou sistemas de pontuação social

- Monitorar o desdobramento jurídico - a Anthropic anunciou intenção de processar o governo americano, indicando que esta história ainda não chegou ao fim

Resumo para o cidadão brasileiro: O governo americano priorizou velocidade e poder militar em detrimento de limites éticos estabelecidos. A Anthropic perdeu contratos significativos por manter seus princípios, enquanto OpenAI e Grok foram selecionados, mas enfrentam questionamentos sobre confiança e transparência. A reação pública demonstra crescente conscientização sobre os valores incorporados nas tecnologias que utilizamos diariamente.