Famílias das vítimas de um dos massacres mais mortais da história do Canadá entraram com uma ação judicial contra a OpenAI, criadora do ChatGPT, e seu CEO, Sam Altman, em um tribunal federal dos Estados Unidos, nesta quarta-feira, 29 de janeiro. O processo alega que a empresa identificou a atiradora como uma potencial ameaça oito meses antes do ataque, mas não alertou as autoridades policiais.

O massacre em Tumbler Ridge

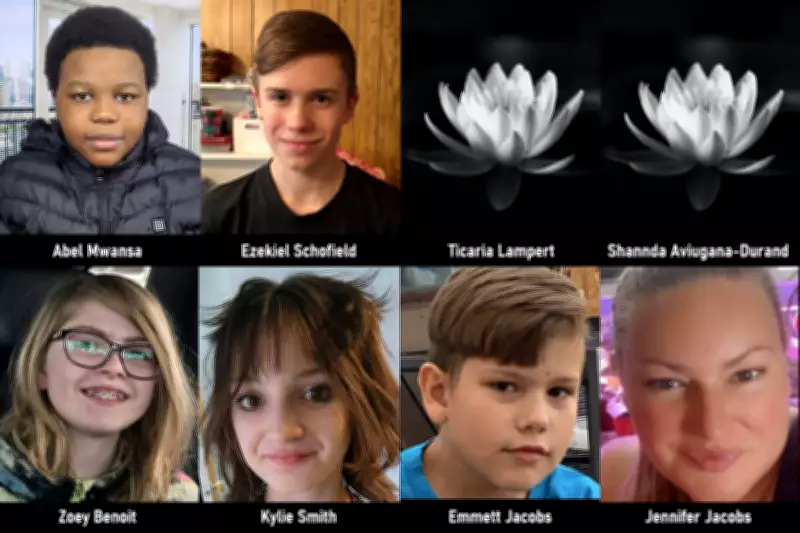

O trágico evento ocorreu em fevereiro de 2026, na cidade de Tumbler Ridge, localizada na Colúmbia Britânica, Canadá. Uma atiradora matou oito pessoas, muitas delas crianças, e cometeu suicídio em seguida. O ataque aconteceu em uma escola local, deixando a comunidade em choque e luto.

Acusações contra a OpenAI

De acordo com a alegação dos familiares, a OpenAI teria detectado comportamentos preocupantes da atiradora em interações com o ChatGPT, mas optou por não informar a polícia. Os autores do processo argumentam que a empresa teria silenciado a ameaça para evitar expor o volume de conversas relacionadas à violência na plataforma, o que poderia comprometer seus planos de uma oferta pública inicial avaliada em quase US$ 1 trilhão.

As ações foram protocoladas no tribunal federal de São Francisco e fazem parte de uma onda crescente de processos contra empresas de inteligência artificial. Estas são as primeiras ações nos EUA a alegar que o ChatGPT teve um papel direto na facilitação de um massacre em massa.

Resposta da OpenAI

Um porta-voz da OpenAI classificou o tiroteio como “uma tragédia” e declarou que a empresa possui uma política de tolerância zero para o uso de suas ferramentas na facilitação de atos violentos. “Como compartilhamos com as autoridades canadenses, já fortalecemos nossas salvaguardas, incluindo a melhoria de como o ChatGPT responde a sinais de angústia, conectando pessoas com suporte local e recursos de saúde mental, reforçando como avaliamos e escalamos ameaças potenciais de violência e aprimorando a detecção de reincidência de violadores de políticas”, afirmou o porta-voz em comunicado oficial.

Onda de processos contra IA

Os casos integram uma série de litígios que acusam empresas de inteligência artificial de não prevenirem interações em chatbots que, segundo os autores, contribuem para automutilação, doenças mentais e violência. O advogado Jay Edelson, que representa os familiares das vítimas, anunciou que planeja apresentar mais de vinte novas ações judiciais contra a OpenAI nas próximas semanas, em nome de outras pessoas impactadas pelo massacre.

Além disso, a ação destaca a responsabilidade das empresas de tecnologia em monitorar e reportar ameaças potenciais, especialmente quando envolvem violência em massa. Os familiares esperam que o processo traga justiça e promova mudanças nas políticas de segurança das plataformas de IA.